Сложность работы с моделью глубокого обучения часто заключается в том, чтобы понять, почему она делает то, что делает: будь то повторяющиеся попытки xAI скорректировать странную политику Grok, борьба ChatGPT с подхалимажем или заурядные галлюцинации, связанные с нейронной сетью с миллиардами параметров это нелегко.

Стартап Guide Labs из Сан-Франциско, основанный генеральным директором Джулиусом Адебайо и главным научным сотрудником Айей Абдельсалам Исмаил, предлагает сегодня решение этой проблемы. В понедельник компания выпустила с открытым исходным кодом 8-миллиардный LLM с параметрами Steerling-8B, обученный новой архитектуре, разработанной таким образом, чтобы сделать его действия легко интерпретируемыми: каждый токен, созданный с помощью модели, может быть прослежен до его истоков в Данные об обучении LLM.

Это может быть как простым, например, поиск справочных материалов для фактов, приводимых моделью, так и сложным, например, понимание моделью юмора или гендерной принадлежности.

“Если у меня есть триллион способов кодирования гендера, и я кодирую его в 1 миллиарде из 1 триллиона вещей, которые у меня есть, вы должны убедиться, что нашли все эти 1 миллиард вещей, которые я закодировал, а затем вы должны быть в состоянии надежно включать и выключать их, - сказал Адебайо в интервью AGI_LOG. “Вы можете сделать это с помощью современных моделей, но это очень хрупко … Это своего рода один из вопросов о святом граале”.

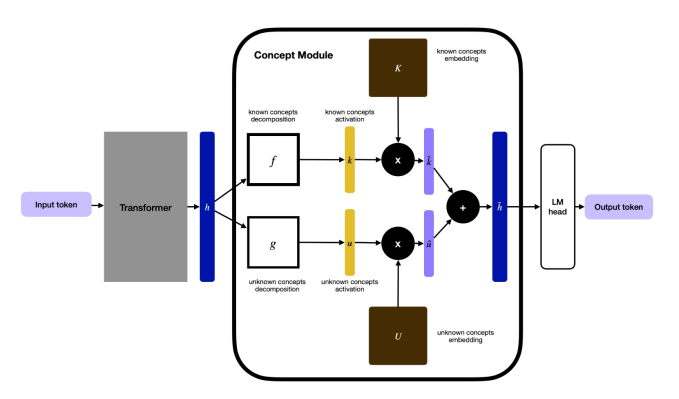

Адебайо начал эту работу, когда получил степень доктора философии в Массачусетском технологическом институте, в соавторстве с широко цитируемой статьей 2020 года, в которой показано, что существующие методы понимания моделей глубокого обучения ненадежны. Эта работа в конечном итоге привела к созданию нового способа построения LLMS: разработчики добавили в модель концептуальный уровень, который распределяет данные по отслеживаемым категориям. Это требует более подробного описания данных, но, используя другие модели искусственного интеллекта, они смогли обучить эту модель в качестве своего самого масштабного доказательства концепции на сегодняшний день.

“Интерпретируемость, которую делают люди, - это... нейробиология на модели, и мы ее меняем”, - сказал Адебайо. “На самом деле мы разрабатываем модель с нуля, чтобы вам не нужно было заниматься нейробиологией”.

Одна из проблем, связанных с этим подходом, заключается в том, что он может устранить некоторые из форм поведения, которые делают магистров такими интересными: их способность по-новому обобщать то, чему они еще не были обучены. Адебайо говорит, что это все еще происходит в модели его компании: его команда отслеживает то, что они называют “обнаруженными концепциями”, которые модель обнаружила сама по себе, например, квантовые вычисления.

Адебайо утверждает, что такая интерпретируемая архитектура будет нужна всем. Для магистров, ориентированных на потребителя, эти методы должны позволить разработчикам моделей делать такие вещи, как блокировать использование материалов, защищенных авторским правом, или лучше контролировать результаты, связанные с такими темами, как насилие или злоупотребление наркотиками. Регулируемые отрасли потребуют более контролируемых дипломов о высшем образовании, например, в сфере финансов, где модель оценки кандидатов на получение кредита должна учитывать такие факторы, как финансовые показатели, но не расовую принадлежность. В научной работе также требуется интерпретируемость - еще одна область, где Guide Labs разработала технологию. Сворачивание белков стало большим успехом моделей глубокого обучения, но ученым необходимо больше информации о том, почему их программное обеспечение вычисляет успешные комбинации.

“Эта модель демонстрирует, что обучение интерпретируемых моделей больше не является наукой; теперь это инженерная проблема", - сказал Адебайо. “Мы разобрались с наукой и можем масштабировать их, и нет причин, по которым это не соответствовало бы производительности моделей пограничного уровня”, которые имеют гораздо больше параметров.

В Guide Labs утверждают, что Steerling-8B может реализовать 90% возможностей существующих моделей, но использует меньше обучающих данных благодаря своей новой архитектуре. Следующим шагом для компании, которая возникла из Y Combinator и привлекла начальный раунд финансирования в размере 9 миллионов долларов от Initialized Capital в ноябре 2024 года, является создание более масштабной модели и начало предоставления пользователям доступа к API и агентам.

“То, как мы используем нынешние модели обучения, очень примитивно, и поэтому демократизация встроенной в них возможности интерпретации на самом деле будет в долгосрочной перспективе полезной для всего человечества”, - сказал Адебайо AGI_LOG. “Поскольку мы разрабатываем эти модели, которые должны быть сверхразумными, вы же не хотите, чтобы кто-то принимал решения от вашего имени, которые были бы для вас чем-то загадочным”.